こんにちは、たねやつです。

Googleが、AIモデルをスマートフォンなどの端末上で直接動かすためのデモアプリ「Google AI Edge Gallery」を公開しました。 早速、どのようなアプリなのか、どんな機能が使えるのか、そして気になる制約は何か、試してみましたのでご紹介します。

この記事でわかること

- 「Google AI Edge Gallery」がどんなアプリか

- アプリで利用可能なオンデバイスAIモデルの種類

- アプリの主な機能(Ask Image, Prompt Labなど)

- 利用上の制約や注意点

Google AI Edge Galleryとは?

「Google AI Edge Gallery」は、Googleが開発した、AIモデルをクラウド経由ではなく、スマートフォンなどのエッジデバイス上で直接実行するためのデモアプリケーションです。 これにより、オフライン環境でもAI機能を利用できる可能性が広がります。

使用できるAIモデル

現在、アプリ内で使用できるとされているモデルは以下の通りです。すべてGemmaファミリーのモデルですね。

Gemma3-1b-itGemma-3n-E2B-itGemma-3n-E4B-it

主な機能

アプリには、いくつかの機能が搭載されています。

Ask Image

デバイス上にある画像をアップロードし、その画像について質問することができます。画像の内容をAIが理解して回答を生成する機能です。

Audio Scribe

マイクで録音した音声をテキストに書き起こす「文字起こし」機能です。30秒以内のファイルしか扱えないようです。

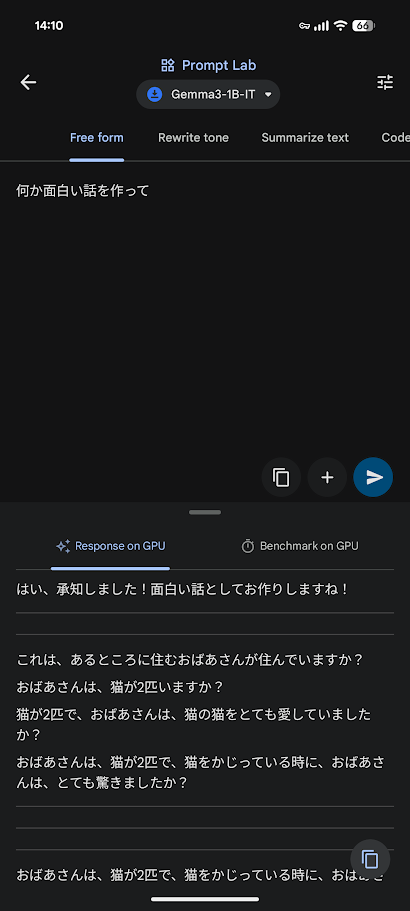

Prompt Lab

AIとのチャット機能ですが、後述の「AI Chat」よりも長文の回答を生成してくれるモードのようです。より複雑な指示に応用できそうです。

AI Chat

一般的なAIチャット機能です。簡単な質問や文章生成などを試すことができます。

注意点と制約

実際に使ってみてわかった、いくつかの注意点や制約事項です。

- メモリの壁: 端末に搭載されているメモリ量を超える大きさのモデルは実行できません。

- Pixel 8での制限: 私の環境(Pixel 8)では、「Gemma-3n-E4B-it」モデルを実行しようとすると「アプリがクラッシュする可能性がある」という警告が表示され、事実上使用できませんでした。

- 日本語の性能:

Gemma3-1b-itモデルで日本語を使ってみましたが、正直なところ、実用は厳しいという印象でした。Gemma-3n-E2B-itモデルは、1Bモデルよりは日本語の受け答えが自然になっていますが、CPUで処理が(一部?)実行されるため返答が少し遅いです。SoCについてあまり詳しく知らないのですが、GPUのVRAM上にモデルが乗りきっていない可能性があります。

- HuggingFaceのアカウントが必要: モデルのダウンロードにはhuggingfaceのアカウントとモデル使用時に同意が必要です。

最後に

今回は、Googleの新しいオンデバイスAIアプリ「AI Edge Gallery」についてご紹介しました。 まだデモ段階であり、特に日本語での利用には課題も感じられましたが、AIがより身近なデバイスで直接動く未来を体験できる、非常に興味深いアプリでした。

特に、Pixel 8ではメモリの制約から最上位のモデルが試せなかったのが残念ですが、今後のスマートフォンの高性能化やモデルの軽量化によって、このような技術が当たり前になっていくのかもしれません。

今後のアップデートに期待したいですね!